微软要下场训练自己的AI编程模型了

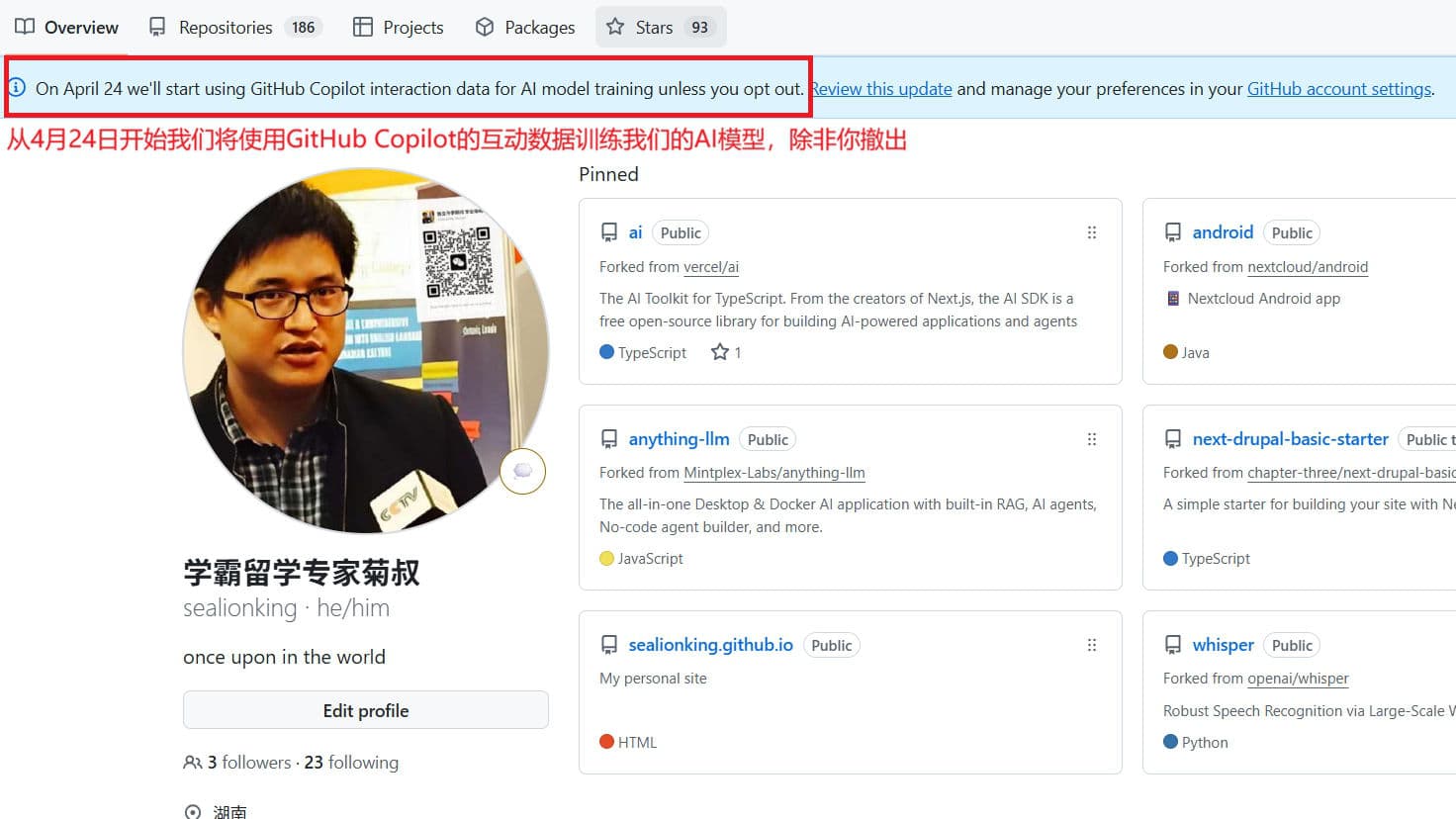

github发了题图那个通知,我是这么看的:

1、微软知道openAI靠不住,不能一棵树上吊死

2、Vibe Coding是LLM based AI的最主要token消耗场所,现在最佳的vibe coding模型claude opus 4.6,和openAI的codex 5.3,他们都是依赖公开的编程论坛社区数据训练的,比如over stackflow;微软持有的github坐拥世界最大的软件代码托管与交互平台,不用这些数据训练自己的coding models简直是愚不可及。

3、LLM based AI在大众市场的应用其实是非常有限的,最常用的就一个chat,之前有个统计,tokens消耗最多的vibe coding,也就是AI编程,tokens消耗占比达80%。

4、之前有人说了,200刀/月claude code的订阅,实际上消耗Anthropic公司4000刀的算力还不止呢。所以可见现在的LLM based AI就是这样一种应用场景匮乏,收入能力有限,而计算资源消耗巨大的行业。

5、这两天用自己专有芯片TPU的谷歌,他妈的都大幅度打击那些免费的gemini cli用户和antigravity free tier用户的模型用量,而且还不给免费用户用gemini pro模型了。可见地主家也没有那么多算力给大家随便薅了。

6、再联想到昨天openAI宣布放弃他们AI 视频app平台sora,并且还内涵了李飞飞和杨乐昆的世界模型,world models。他们是这么说的:

“As we focus and compute demand grows, the Sora research team continues to focus on world simulation research to advance robotics that will help people solve real-world, physical tasks,” an OpenAI spokesperson said in a statement to CBS News.

「隨著我們的關注重點和計算需求不斷增長,Sora 研究團隊將繼續專注於世界模擬研究,以推進機器人技術,幫助人們解決現實世界中的物理任務。」OpenAI 一位發言人在給 CBS News 的一份聲明中表示。

他妈的这外交辞令,他们的真实意思就是要把计算资源和关注重点转向非视频和世界模型。

总体而言菊叔我的感觉就是,LLM based AI 大模型现在的scaling law(规模法则)已经到了一个瓶颈期了。但是大模型的智能离AGI还很远呢,正如我昨天写的《AI其实不会思考》。那么现在最佳的应用场景就是最消耗tokens的场景,vibe coding,也就是AI编程。

所以,微软下属的github下场用github的海量数据训练自己的AI模型,这是很好的事情。希望他们能够训练出来一个比claude和codex都不若的模型。这样子市场上的竞争更激烈一些。对于消费者的我们,自然是有好处的。

特别的,他们特别指出这个计划的数据不会与第三方AI模型公司共享,剑指openAI和Anthropic和Google的意味非常明显。微软终于是发现奥特曼这家伙不可靠了,要自己下场训练自己的编码模型。

希望半年以后,他们至少可以把gemini 3.5 pro搞到又向免费用户和gemini cli用户开放。

具体如下:

GitHub Copilot 交互数据使用政策的更新

从 2026 年 4 月 24 日起,除非用户选择退出,否则 GitHub Copilot Free、Pro 和 Pro+ 用户的交互数据——具体包括输入、输出、代码片段以及相关上下文——将被用于训练和改进我们的 AI 模型。

2026 年 3 月 25 日

今天,我们宣布一项关于 GitHub 如何使用数据来提供更智能、上下文感知的编码协助的更新。从 4 月 24 日起,除非用户选择退出,否则 GitHub Copilot Free、Pro 和 Pro+ 用户的交互数据——具体包括输入、输出、代码片段以及相关上下文——将被用于训练和改进我们的 AI 模型。Copilot Business 和 Copilot Enterprise 用户不受此更新影响。

不感兴趣?请在设置的“隐私”部分选择退出。如果您之前已经选择退出允许 GitHub 收集此数据用于产品改进的设置,您的偏好已被保留——您的选择将被保留,您的交互数据不会被用于训练,除非您主动选择加入。

这种做法符合行业既定惯例,将提升所有用户的模型性能。通过参与,您将帮助我们的模型更好地理解开发工作流程,提供更准确、更安全的代码模式建议,并提升它们在代码进入生产环境前帮助您捕获潜在 bug 的能力。

真实世界数据 = 更智能的模型

我们的初始模型是基于公开可用数据和手工制作的代码样本构建的。在过去一年中,我们已开始纳入来自微软员工的交互数据,并看到了显著改进,包括多种编程语言的接受率提升。

纳入微软交互数据后取得的改进表明,通过在真实世界的交互数据上进行训练,我们能够为更广泛的使用场景提升模型性能。如果您决定参与此计划,我们可能收集和利用的交互数据包括:

您接受或修改的输出

发送给 GitHub Copilot 的输入,包括向模型展示的代码片段

光标位置周围的代码上下文

您编写的注释和文档

文件名、仓库结构以及导航模式

与 Copilot 功能的交互(聊天、内联建议等)

您对建议的反馈(点赞/点踩评分)

此计划不会使用以下数据:

来自 Copilot Business、Copilot Enterprise 或企业拥有仓库的交互数据

来自在 Copilot 设置中选择退出模型训练的用户的交互数据

来自您的 Issue、讨论或私有仓库“静态”内容。我们特意使用“at rest”(静态)一词,因为当您主动使用 Copilot 时,Copilot 会处理私有仓库中的代码。此交互数据是运行服务所必需的,除非您选择退出,否则可能被用于模型训练。

用于此计划的数据可能会与 GitHub 的关联公司(即我们企业家族中的公司,包括微软)共享,但不会与第三方 AI 模型提供商或其他独立服务提供商共享。

我们相信,AI 辅助开发的未来取决于像您这样的开发者提供的真实世界交互数据。这正是我们使用微软交互数据进行模型训练、并即将开始使用 GitHub 员工交互数据的原因。

如果您选择用自己的交互数据帮助我们改进模型,衷心感谢您!您的贡献对构建服务于整个开发者社区的 AI 工具具有重要意义。如果您不想参与,也完全没问题——您仍可继续充分使用您熟悉和喜爱的 AI 功能。

让我们共同构建能够加速您工作流程的 AI,帮助您更快地构建更好、更安全的软件。

如果您有任何疑问,请访问我们的[相关文档]。